法院叫停封杀Anthropic!美国政府7天内可上诉

智东西

编译 | 陈佳

编辑 | 程茜

智东西3月27日消息,据外媒彭博社今日报道,美国加利福尼亚州北区联邦地区法院法官林丽塔(Rita F. Lin)于3月27日发布初步禁令,叫停美国政府对Claude大语言模型开发商Anthropic的相关限制措施。禁令要求美国政府停止执行将Anthropic列为国家安全“供应链风险”的认定,并暂停总统要求联邦机构停止与Anthropic合作并停用其技术的指令。法官林丽塔同时要求美国政府在4月6日前提交报告,详细说明对判决的执行情况。

Anthropic发表声明,乐见法官作出此裁决。该公司称:“尽管提起诉讼对保护Anthropic、客户及合作伙伴而言十分必要,但我们仍将专注于与美国政府开展高效合作,确保全体美国人都能从安全、可靠的人工智能中受益。”

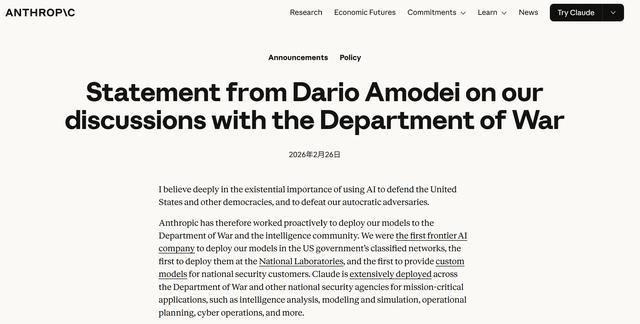

Anthropic CEO达里奥·阿莫代(Dario Amodei)关于美国国防部的声明(图源:Anthropic)

法官林丽塔在裁决书中称:“如果问题在于作战指挥链的完整性,战争部(美国国防部)大可直接停止使用Claude。这些措施看起来是为了惩罚Anthropic。”她进一步将美国政府的行为定性为“典型的、违反宪法第一修正案的非法报复”,即美国政府因不满Anthropic公开言论而对其采取不利措施,违反了美国宪法对言论自由的保护。

国家安全“供应链风险”认定此前只被用于外国对手,从未指向美国本土科技企业。法官的这一裁决使争议焦点从安全审查直接转向美国政府是否在借国家安全之名实施政治打压。

林丽塔将裁定暂缓执行七天,为美国政府留出上诉机会。而美国政府此前就已明确表态将继续上诉,意图将Anthropic逐出所有美国政府机构,这场围绕AI军事应用边界的法律拉锯战仍将持续。

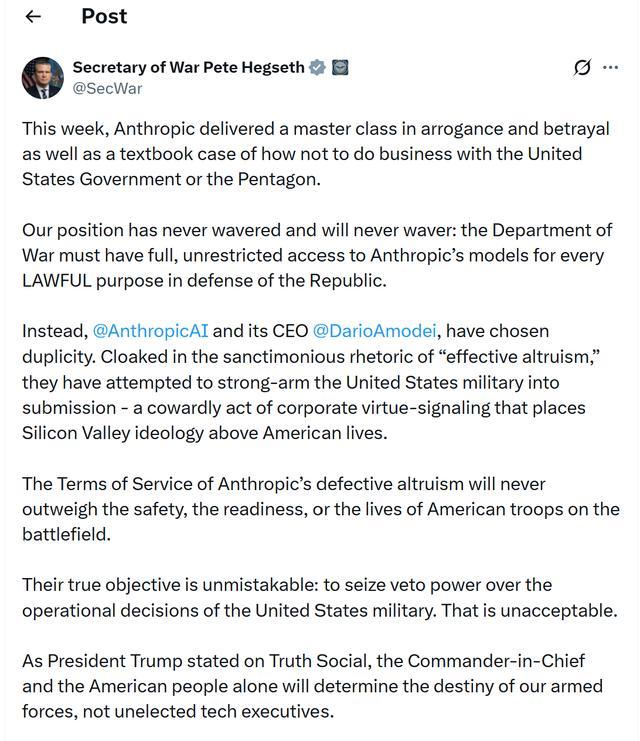

美国国防部长皮特·赫格塞斯(Pete Hegseth)2月28日在社交媒体X平台上发文,要求所有与军方合作的承包商和供应商停止使用Anthropic的产品。

美国国防部长皮特·赫格塞斯(Pete Hegseth)在X平台发文截图(图源:X)

Anthropic在诉讼中称,Hegseth的发文导致大量合同被取消、缩减或搁置,造成数亿美元损失。林丽塔法官判决禁止执行Hegseth通过社交媒体发布的相关指令。

一、法院叫停美国政府限制措施,质疑国家安全理由站不住脚

此次裁决不仅叫停具体封杀政策,也直接指向美国国防部将Anthropic列为国家安全“供应链风险”这一认定的合法性基础。法官林丽塔认为,将一家美国AI企业认定为供应链风险并限制联邦机构使用其模型,已触及言论自由保护问题,而现有记录显示,这一决定并未建立在清晰的国家安全威胁之上。

她在判决中写道,如果担忧的是军事指挥链的完整性,美国国防部完全可以停止使用Anthropic的大语言模型Claude,而不是扩大为跨机构的全面限制措施,这种做法与美国防部声称的安全目标并不匹配。她进一步指出,“这些措施更像是在惩罚Anthropic”,并将其定性为典型的、有违宪法第一修正案的报复行为。

林丽塔同时根据美国防部提交的材料称,该部门之所以将Anthropic列为风险,与Anthropic在媒体上的“敌对态度”有关,而非具体技术或供应链问题。这一判断使争议焦点从安全审查转向美国政府是否因企业立场而实施打压

在此前的听证会上,林丽塔已表达类似看法。她指出,美国政府将企业列为供应链风险的标准过于宽松,仅因与美国政府存在分歧、提出质疑就采取限制措施,门槛“相当低”,并形容相关行为“过于极端”。

二、军方与AI公司谈判破裂,限制军用场景成为冲突核心

此前,Anthropic于2025年7月与美国国防部签署一份上限约2亿美元(约合人民币13.83亿元)的协议,Claude成为较早进入美军涉密网络的商业AI模型之一。双方围绕AI使用协议展开几次谈判,但最终破裂。美国政府于2月27日将Anthropic列为国家安全“供应链风险”并下令所有联邦机构停止合作。3月3日美国国防部长Hegseth在社交媒体X平台上发文,要求所有与军方合作的承包商和供应商停止使用Anthropic的产品。这些措施的接连落地,成为此次诉讼的直接触发点。

美国国防部长皮特·赫格塞斯(Pete Hegseth)(图源:维基百科)

分歧集中在AI的具体使用边界。Anthropic在谈判中要求明确承诺,其大模型不会被用于对美国民众的大规模监控或自主武器部署,这一立场贯穿谈判过程,也成为美国政府认定其“不可靠”的重要背景。五角大楼则认为,现有法律和军规已对相关用途作出限制,没有必要接受企业额外设定的约束,并坚持在所有合法场景中使用AI的权利。

在法庭上,美国政府律师说,信任是军方与服务提供企业合作的核心要素,而Anthropic在合同谈判中试图左右五角大楼的AI使用政策,已然破坏了这份信任。该律师称,美国政府担忧Anthropic存在“未来蓄意破坏”的风险,包括擅自修改美国政府从其采购的AI软件。

Anthropic则从技术与流程层面回应这一指控。Anthropic的律师认为,五角大楼在部署任何模型前都拥有完整审查权,企业既无法远程关闭模型,也无法改变其运行方式,更无法获知具体使用场景,所谓“破坏风险”缺乏现实基础。

林丽塔法官在裁决中指出,美国司法部没有提供合理依据证明Anthropic坚持限制AI用途,会导致其成为潜在的“破坏者”。

美国五角大楼(图源:维基百科)

三、商业与法律双重压力叠加,美国政府合同成为关键变量

在政策冲突之外,美国政府合同正在成为影响Anthropic处境的关键变量。随着美国政府要求联邦机构停止合作,并通过行政命令与官员表态推动承包商同步退出,Anthropic称相关措施已导致数亿美元规模的合同被取消、缩减或搁置,若禁令持续,整体收入损失可能扩大至数十亿美元。

Anthropic CEO达里奥·阿莫代(Dario Amodei)(图源:法新社)

这一影响不仅来自正式政策,也来自非正式信号。美国国防部长Hegseth在社交媒体上要求军方供应链停止使用Anthropic技术,该表态的法律效力在法庭上受到质疑。法院裁决明确禁止执行通过社交媒体发布的相关指令,显示行政权在具体执行层面仍存在边界。

除在加州联邦法院申请禁令外,Anthropic还在华盛顿特区上诉法院围绕规范采购环节供应链风险防控程序的相关法律提起诉讼,试图从采购法规层面推翻这一决定。Anthropic在诉讼中指控国防部在“供应链风险”认定中程序不当,行为“武断专横、滥用裁量权”,属于越权行事。美国政府已誓言通过法律手段,将Anthropic彻底排除出所有美国政府机构的合作范围,案件进入拉锯状态。

从庭审披露的信息看,争议已不局限于单一合同,而是涉及联邦采购体系如何界定风险、如何处理与承包商的分歧。Anthropic认为,若美国政府可以因立场不同而将企业排除在合同体系之外,这一先例将影响所有联邦承包商;而美国政府则试图将问题界定为信任与安全风险,从而为其决策提供更大裁量空间。

结语:AI治理进入博弈阶段,法律、政府与市场开始交叉约束

此次发布的禁令标志着Anthropic在与美国国防部的法律博弈中赢得初步胜利,但后续案件进展仍取决于上诉结果及进一步审理情况,相关政策与合作安排也可能随之调整。美国政府此前就已表明,若法院颁布禁令,将继续上诉。

从更长周期看,当大模型逐渐成为关键基础设施,类似冲突可能会更频繁出现。企业是否可以对技术用途设置边界,美国政府在国家安全名义下的权力范围如何界定,这些问题还没有答案。

(来源:新浪科技)