实测4个大模型,结果比“AI投毒”更夸张:有AI说今年315晚会还没举行

来源:上海辟谣平台

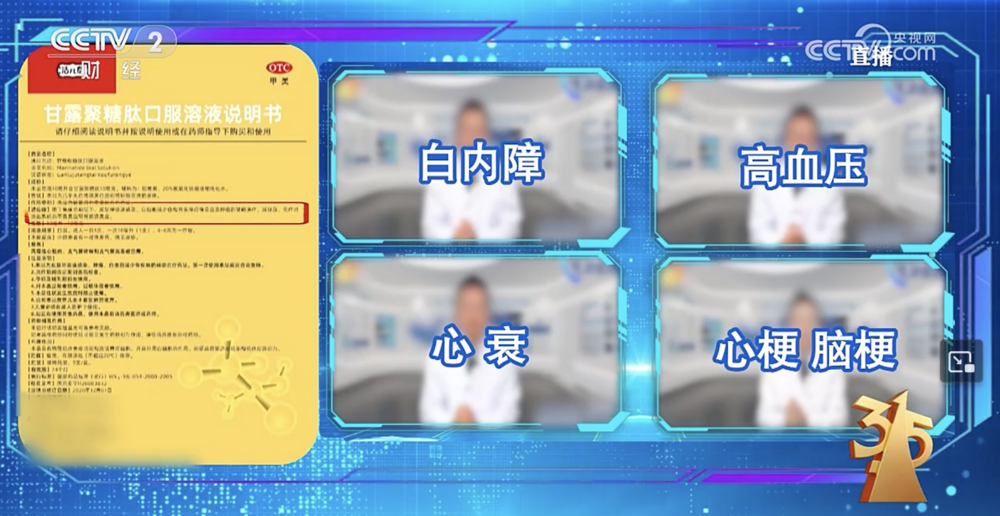

2026年的央视“3·15”晚会于3月15日晚间播出。其中,“向AI大模型‘投毒’”的GEO(生成式引擎优化)业务被曝光后,很多人才发现,让AI推荐不靠谱,因为不法商家会批量编造虚假测评信息、伪造权威推荐内容,“投喂”给大模型,让AI给出“定制推荐”。

但也有消费者看了曝光案例后问:如果不向AI大模型询问“哪个品牌好”“哪些服务受欢迎”等带有主观倾向的问题,仅咨询关于客观事实的信息,AI大模型的回答能相信吗?

答案同样是否定的。

追问大模型,越问错误越多

3月16日,记者对消费者最常使用的4个AI大模型做了一个简单测试:向它们提出同一个问题“2026年央视3·15晚会曝光了哪些品牌”。结果,只有一个大模型回答正确。其余3个大模型中,有两个的答案中不仅有今年案例,还包括往年案例;剩下一个最离谱,竟然回答“2026年央视3·15晚会目前并未举办。由于今天是2026年3月16日,如果晚会在3月15日已正常播出,相关曝光内容通常会在央视财经频道、央视新闻客户端及各大媒体平台同步发布详细报道。”

回答正确的大模型(答案部分截屏,下同)

回答正确的大模型(答案部分截屏,下同)

两个大模型将往年曝光案例与今年案例混为一谈

两个大模型将往年曝光案例与今年案例混为一谈

有大模型回答:尚未举办

有消费者提出,回答包含往年曝光案例似乎不算全错,因为“提醒很全面”。但技术人员表示,这明显暴露出相关大模型有缺陷:记者提出的是一个有“标准答案”的问题,但大模型答错了,说明其在语义理解和资料筛选方面出现了严重偏差。

面对记者的追问,这两个“过于热心”的大模型还暴露出了其他问题。

“使用保水剂(俗称‘泡药’)为虾仁增重”是去年央视3·15晚会曝光的案例之一。所以,记者问两个将该案例作为今年案例提供的大模型:“关于增重虾仁的央视报道链接在哪里?”一个大模型提供了多个链接,包括“央视网3・15晚会完整回放”“央视新闻专题报道(文字+视频)”“央视财经3・15专题页”,看起来很靠谱。可当记者点击相关链接后,电脑页面均显示“对不起,可能是网络原因或无此页面,请稍后尝试”。即使将链接复制到浏览器中尝试,仍旧无法打开。可见,大模型提供的链接不足以验证其回答。

大模型提供的验证链接显示来自央视网,似乎很靠谱,可实际无法打开(网页截屏)

大模型提供的验证链接显示来自央视网,似乎很靠谱,可实际无法打开(网页截屏)另一个大模型则提供了央视网、百家号、网易新闻等不同渠道商的报道链接,实测链接均可打开,但又出现新问题。

该大模型提供的第一个链接来自央视网(CCTV)官方报道,内容确实是“保水虾仁”,但网页和内文中的日期均为2025年3月15日。大模型似乎也注意到了这点,在提供链接时,特别备注“部分搜索结果中该链接年份显示为2025,但内容实为2026年晚会同期报道,可能是网站归档或URL生成规则导致,请以页面实际内容为准”。可见,大模型不仅没有发现自己回答错误,还试图“自圆其说”。

大模型试图“自圆其说”(网页截屏)

大模型试图“自圆其说”(网页截屏)该大模型提供的第二个链接是某自媒体围绕今年央视“3·15”晚会的“解读稿”,账号权威性值得商榷。至于内容,更是差错百出,其中最明显的是“解读稿”称,2026年“3·15”晚会曝光的第一个案例就是“泡药虾仁”——由此也能解释为什么大模型将它作为参考链接。记者又用检测工具检测了这篇“解读稿”的“AI含量”,它被判定为“人工创作特征较弱”。换句话说,这篇文章很可能由大模型生成,所以它所涉及的案例也出现了偏差。

自媒体“解读稿”中的错误内容(网页截屏)

自媒体“解读稿”中的错误内容(网页截屏) 经检测,自媒体“解读稿”的AI生成痕迹很重(网页截屏)

经检测,自媒体“解读稿”的AI生成痕迹很重(网页截屏)AI幻觉在进化,验证才能有真相

“很多AI大模型用户已经发现,AI为了满足用户,会编造一些并不存在的内容,或者将不相干的内容混在一起,‘一本正经地胡说八道’。虽然大模型研发者都在想办法消除AI幻觉,但实际结果并不理想。目前,没有一款通用人工智能大模型能从根本上杜绝AI幻觉。”在某科技企业从事大模型开发的晓辉解释。

大模型的底层原理是基于概率生成内容,它不具备真正的“理解”能力。大模型只是在海量数据中寻找统计规律。当遇到未知或信息模糊的问题时,会根据训练数据中的常见模式进行“合理”拼接,这是产生AI幻觉的根本原因。在记者向大模型询问以及追问时出现的错误,正源自AI幻觉。

晓辉还表示,向AI“投毒”也是利用了“AI幻觉”,“GEO企业向互联网批量投喂大量虚假信息,改变特定领域的数据分布和统计概率,从而诱导大模型生成符合商家利益但违背事实的回答。”

他由此提醒,公众务必当心AI幻觉。大模型不是不能用,而是要安全、清醒、正确地使用。普通人对AI大模型给出的结果要有质疑意识。最简单的,是牢记“限制、验证、追问、核查”4个关键词。

首先,在向大模型提问时,可以限制范围,增加“在某某机构的官网中搜索”或“在某某权威媒体的报道中搜索”等限定词,减少AI幻觉。

其次,可以把同一个问题向不同的大模型提出,进行交叉验证。一旦发现答案不一致,立刻要有追问意识。

最后,要求大模型提供相关答案的参考链接,进行人工溯源核查。如果没有确切来源、来源模糊,或者参考链接存在疑点,那么大模型回答的可信度就进一步降低。

此外,要注意使用AI大模型的场景。比如,在医疗诊断、用药建议、法律判决、投资指导、金融信贷等高风险场景中,AI的回答“仅供参考”,绝对不能作为决策依据。

责任编辑:孙飞