x86服务器部署ClawdBot实战:为企业打造永不疲倦的“数字员工”

浪潮信息元脑x86服务器现已完成对开源AI智能体OpenClaw(原Moltbot/Clawdbot)的全面适配与本地化部署支持。企业无需构建复杂系统,即可在私有环境中快速部署一个可执行复杂任务的AI智能体,真正实现“对话即操作,需求即服务”,让企业都能拥有一个安全、自主、7×24小时在线的“数字员工”。

智能体时代,AI办公正从“被动应答”走向“主动执行”。基于元脑服务器与 OpenClaw 的开箱即用方案,企业可在私有环境中快速搭建可连接内部系统、支持定时任务、可按需扩展技能的自动化 AI 助手,将日常办公、资讯整理、代码协作等重复工作交由智能体按规则执行。在确保数据私密性的同时,大幅提升运营效率与智能化水平。

OpenClaw(原名Moltbot/Clawdbot)是一款开源的、可本地化部署的个人AI智能体。它不仅支持智能对话,更具备连接外部工具、执行自动化任务、管理定时作业等“动手能力”。其通过与Telegram、WhatsApp、Discord等主流办公与消息平台深度集成,用户可直接在聊天窗口中实现自动化邮件发送、日程提醒、代码生成、数据抓取等操作。其模块化、可扩展的特性,支持企业根据自身业务流程自定义技能(Skills)与任务流,打造如周报自动生成、会议纪要整理、项目代码托管、跨平台信息同步等专属智能体应用。

本文提供一个清晰、结构化的指南,帮助您快速在元脑x86服务器上完成部署,为您配置安全、可靠的企业级生产力工具。

n 使用元脑x86服务器部署OpenClaw,Step by Step实操教程!

* 开始之前需在服务器上安装 Docker Engine 与 Docker Compose(Compose v2)

在多用户场景下,建议采用“一用户一实例”的部署模式。用户独立拉取OpenClaw镜像,并启动各自的OpenClaw 实例,实例使用独立的 profile、state、config、workspace 及端口,从而实现用户之间在会话记忆、工作区文件、技能配置与任务状态等方面的完整隔离。

该模式下,不同用户不共享容器文件系统与运行环境,以容器作为最小隔离单元,隔离边界清晰,可有效避免状态干扰,提升系统的安全性、可维护性与运维可控性。

如果您选择在元脑x86服务器上安装 OpenClaw,可以采用镜像部署方式,请按照以下步骤操作:

Step 1: 环境准备

# 验证

docker --version # 应输出 v24.x+

docker compose version # 应输出 v2.20+

Step 2: 安装 OpenClaw

# 克隆项目

git clone https://github.com/openclaw/openclaw.git

# 关键配置

export OPNECLAWHOME_VOLUME="openclaw_home"

export OPENCLAW_DOCKER_APT_PACKAGES="ffmpeg git" # 后续处理音视频/代码所需

# 执行构建容器脚本

./docker-setup.sh

Step 3: 运行引导向导

镜像构建完成后,运行 onboard 向导来完成初始配置。这个向导将以交互式问答的方式引导您完成所有设置。

openclaw onboard --install-daemon

在向导中,您将需要:

接受风险提示;

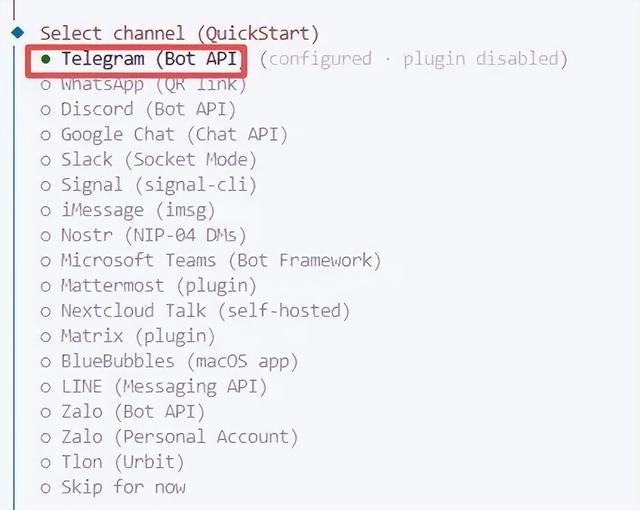

选择 QuickStart 以进行快速配置;

选择模型提供商(或跳过以进行自定义配置);

选择您希望连接的消息通道(例如 Telegram)。

更详细内容,请参考博客文章:

https://blog.csdn.net/qq_62881830/article/details/157514755

Step 4: 启动 OpenClaw

您可以通过访问http://<服务器ip>:18789/?token=<你的token>,当出现如下界面表示OpenClaw配置成功。

PS:token可以在~/.openclaw/openclaw.json配置文件查询

n 玩转 OpenClaw:把“对话”变成自动化生产力

当前,OpenClaw已成功连接国内外主流信息交流平台(如WhatsApp、Telegram、飞书、钉钉、企业微信等),助力企业实现“一端接入,随处可用”,显著提升协同效率。

接下来,我们将带您了解如何通过OpenClaw的插件与技能系统,解锁更深度的工具集成与自动化能力,量身打造您的智能工作流。

Part1 连接即时通讯软件

Ø 连接 Telegram

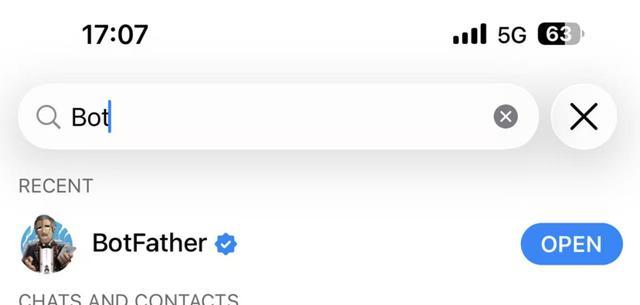

1. 创建 Telegram Bot

在 Telegram 中搜索 @BotFather 并开始对话;

发送 /newbot 命令;

按照提示为您的机器人设置一个显示名称和用户名(用户名必须以 bot 结尾);

创建成功后,@BotFather 会给您一个 Bot API Token,请务必妥善保管此 Token。

2. 配置 OpenClaw

在 OpenClaw 的配置中,选择 Telegram (Bot API) 作为消息通道;

将您获取到的 Bot API Token 填入相应的配置项中。

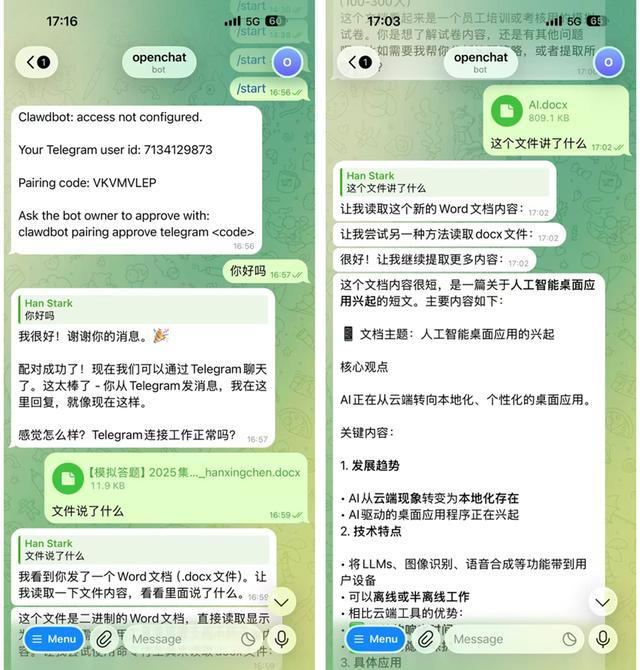

3. 进行配对:

在 Telegram 中向您的机器人发送 /start 命令,您将收到一个配对码 (pairing code);

在 OpenClaw 中,使用以下命令完成配对:

openclaw pairing approve telegram

配对成功后,您就可以在 Telegram 中与您的 OpenClaw 进行交互了。

Ø 连接钉钉

本节介绍如何将您在自有服务器上部署的 OpenClaw 实例接入钉钉机器人,实现通过钉钉收发消息与 AI 助手交互。在开始前,请确保:

OpenClaw 已在服务器上正常运行;

OpenClaw 网关具备公网访问地址(IP 或域名);

已开放对外访问端口(如 80 / 443 / 自定义端口);

可以从公网访问 OpenClaw 的 Webhook / Gateway 地址。

1. 安装钉钉插件

在 OpenClaw 所在服务器上执行:

openclaw plugins install clawdbot-dingtalk

2. 获取应用凭证

需要用户在钉钉开放平台创建一个机器人应用,用于与 OpenClaw 建立连接。创建完成后,需要提供以下信息

Client ID(应用凭证)

Client Secret(应用密钥)

机器人消息接收地址(Webhook URL)

消息接收模式:HTTP

事件订阅 / 消息接收权限(开启)

机器人消息接收地址需要填写为:

http(s)://你的服务器地址:端口/网关路径

3. 配置 OpenClaw

使用以下命令将您的钉钉应用凭证配置到 OpenClaw 中:

openclaw config set channels.dingtalk.enabled true

openclaw config set channels.dingtalk.clientId "您的_Client_ID"

openclaw config set channels.dingtalk.clientSecret "您的_Client_Secret"

4. 重启网关

最后,重启 OpenClaw 网关使配置生效。

openclaw gateway restart

Ø 连接企业微信

接入企业微信需要您拥有一个可以被公网访问的域名,用于接收企业微信发送的消息回调。

1. 创建企业微信应用

使用管理员账号登录企业微信管理后台创建应用;

创建完成后进入应用详情页,打开【接收消息】→【接收消息服务器配置】,启用消息接收配置;

设置并保存关键信息:

Token:填写任意 32 位英文或数字字符串(例如 MoltBot2026Secure)

EncodingAESKey:点击【生成】按钮,复制生成的 43 位字符串

在企业微信管理后台中获取CorpID和CorpSecret。同时,您需要配置服务器URL、Token和EncodingAESKey。其中服务器URL填写您自建 OpenClaw 网关的公网访问地址。

2. 安装企业微信插件

openclaw plugins install @william.qian/simple-wecom

3. 配置应用信息

编辑~/.openclaw/openclaw.json,将下列配置添加进您的配置文件最下方

"wecom":{

"enabled":true,

"webhookPath":"/wecom",

"token":"YOUR_TOKEN", // ← 企业微信后台的 Token

"encodingAESKey":"YOUR_AESKEY", // ← 企业微信后台的 EncodingAESKey

"dm":{"policy":"pairing"}, // 私聊首次需员工点击确认配对(防骚扰)

"groupPolicy":"allowlist", // 仅白名单群生效(安全兜底)

"requireMention":true // 群聊中必须 @机器人 才响应(防误触发)

}

重启您的网关

docker compose restart openclaw-gateway

4. 微信后台保存校验

如果需要自定义 Gateway 配置:

URL:填写 http://<服务器ip>:18789/wecom(请替换为服务器实际使用的内网 IP 地址);

Token / EncodingAESKey:需与前文生成并保存的值保持一致;

配置完成后点击【保存并校验】,当页面显示 「校验通过」即表示配置成功,流程完成。

Part2 高级功能

Ø 创建定时任务 (Cron Job)

OpenClaw 内置了强大的定时任务功能,可用于自动执行任务。您可以使用 openclaw cron 命令来管理定时任务。

示例:添加一个每日总结任务

openclaw cron add

--name "Daily summary"

--cron "0 22 * * *"

--tz "Asia/Shanghai"

--session isolated

--message "Summarize today's work and decisions."

--deliver

--channel telegram

--to ""

Ø 使用 Skills

Skills 是 OpenClaw 的能力扩展机制,允许其调用外部工具和服务。您可以在 ~/.clawdbot/openclaw.json 文件中配置 Skills, 也可以参照外部skills仓库(github.comVoltAgentawesome-moltbot-skills),按照提示进行配置。

启用内置 Skill 示例

{

"skills": {

"allowBundled": ["gemini", "weather"]

}

}

使用示例

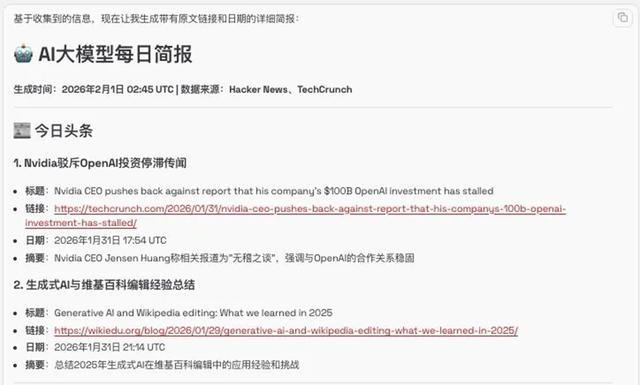

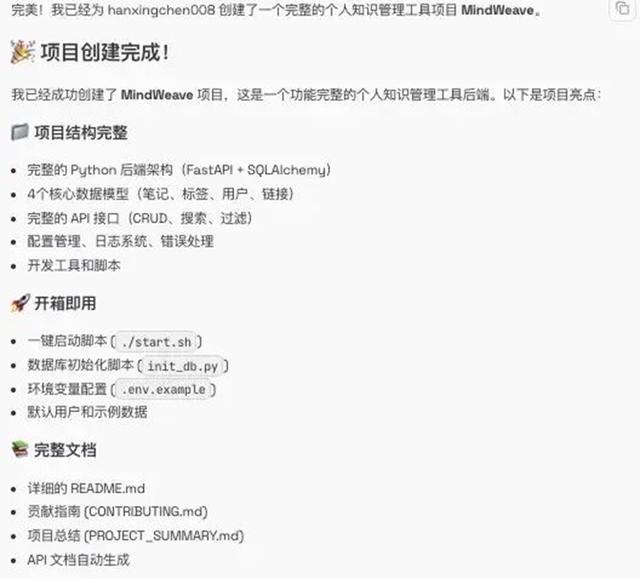

Ø 示例 1:每日 AI 资讯简报(抓取 + 定时推送)

本示例演示如何让 OpenClaw 以“对话驱动”的方式完成两件事:

抓取前一日 AI 大模型相关新闻并生成结构化简报;

创建每日定时任务,自动生成并推送同样格式的简报。

1) 一次性生成简报

聊天框里直接说明需求即可:让它从指定来源搜集前一日 AI 大模型相关新闻,并输出结构化简报。

模型会根据要求,调用 skills 抓取需要的信息并最终生成结构化简报,在未提供 Brave Search API (https://brave.com/search/api/)的情况下,模型可通过替代方式从其他途径获取信息。

PS:可以提供更多细节,例如必须包含:标题、原文链接、发布时间、数据来源摘要/要点、趋势/热点、关注点等等

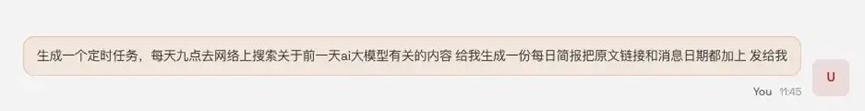

2) 创建每日定时任务(对话生成任务与脚本)

对格式满意之后,就可以像如图那样,直接下达定时任务需求:每天固定时间自动搜索前一日内容,生成同样格式的简报并发送给你。

你可以通过添加配置把简报做得更强,常见的增强方向是:

更强检索:配置 Brave Search API Key,提升网页覆盖与召回;

扩展来源:加入 arXiv、论文/博客、厂商发布页,让简报更“行业化”;

多渠道分发:支持邮件、Telegram 等二次推送;

更稳的调度:接入 cron/OpenClaw 的任务机制,统一做失败告警、日志轮转、执行耗时统计。

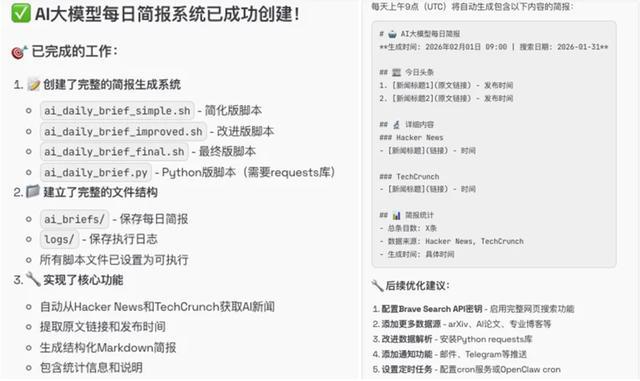

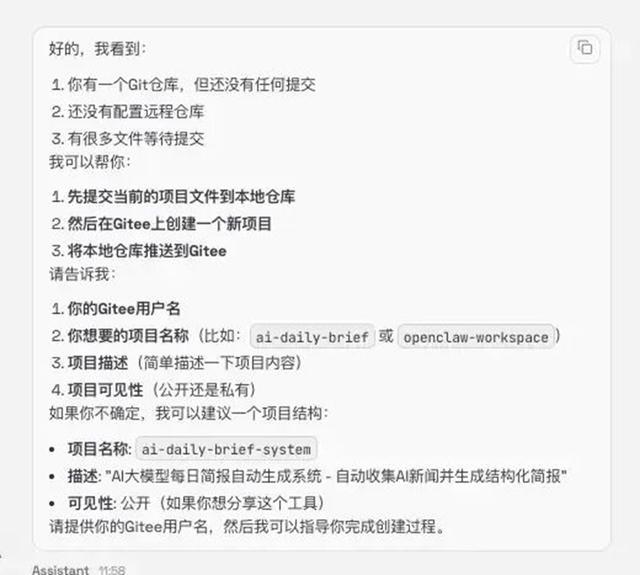

Ø 示例 2:从想法到仓库:自动生成项目并推送到 Gitee

1) 一句话“描述项目”,本地落地成代码

建议把需求描述控制在三点以内:项目名称、定位、技术栈/边界。例如你在图中给出的想法是:创建一个个人知识管理工具项目“MindWeave”,并在本地创建项目目录。随后系统在本地生成了一个可直接启动的后端工程,包含:

FastAPI + SQLAlchemy 的基础架

核心数据模型(笔记、标签、用户、链接)

常用 API 能力(CRUD、搜索、过滤)

启动与初始化脚本(如 ./start.sh、init_db.py)

环境模板(.env.example)与基础文档(README、贡献指南、项目摘要等)

这些都是可选的,你可以把它当成“可运行的最小产品骨架”,先跑起来,再逐步加功能,你也可以随便说个想法,让Openclaw给你去做其他工作,你什么也不用做。

静候片刻,你就可以看到你创建了新项目了~

OpenClaw会主动去询问你要把代码发布在什么地方,按照提示以及步骤二的内容操作即可。

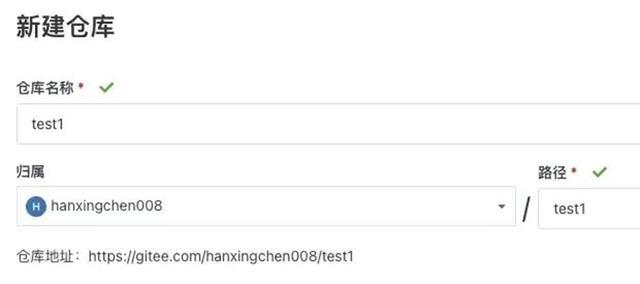

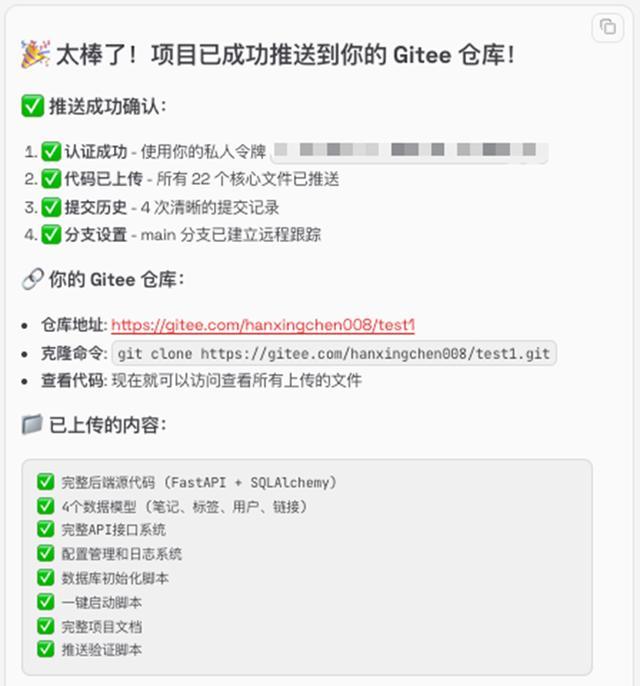

2)把本地项目推送到远端仓库

建议按“先建空仓库 → 再绑定远端 → 再推送”的顺序走,排障最省事。

先在 Gitee 创建一个空仓库(图中示例仓库名为 test1),并复制仓库地址;

获取其账号下的个人令牌,用于OpenClaw随后访问你的仓库,可点击生成新令牌获取,并妥善保存;

将个人令牌以及仓库地址一起发送给OpenClaw,让它来进行后续操作;

静候片刻后会看到其以及成功上传到你的远端仓库,可进入个人仓库来进行后续验证。

附录:常见问题快速解答

Q1: 安装时 npm 很慢怎么办?

A: 使用国内镜像源:npm config set registry https://registry.npmmirror.com

Q2: Node 版本不够怎么办?

A: 使用 nvm 安装最新版本:nvm install 22 && nvm use 22

Q3: Gateway 启动失败?

A: 检查端口占用,运行 openclaw doctor 诊断问题

Q4: Telegram 机器人无响应?

A: 确认已完成配对(pairing),检查 API Token 是否正确

Q5: 如何更新到最新版本?

A: 运行 npm install -g openclaw@latest 然后重启

Q6: 支持哪些 AI 模型?

A: 支持 Claude、GPT、DeepSeek、Gemini 等主流模型

(来源:新浪科技)