DeepSeek 开放识图模式,跨入图文交互时代

据IT之家报道,上个月底,DeepSeek 开始灰度测试“识图模式”。该模式并非简单的文字 OCR,而是终于具备了图片识别理解能力。最新据用户反馈,DeepSeek 已经大范围开放“识图模式”供用户体验,目前几乎所有测试账号都能看到该入口。

拥有灰度测试资格的用户会发现,输入框上方与“快速模式”和“专家模式”并列,出现了一个全新的“识图模式”按钮。在具体的实测体验中,开启该模式后,用户可以直接上传图片让 DeepSeek“看”世界,其能力边界远超简单的文字提取。

在基础的图像识别领域,它成功变身为一名“博物学家”,例如有网友上传了在博物馆拍摄的不明文物,开启“深度思考”后,DeepSeek 不仅详细描述了纹理与材质,甚至准确推断出某件玉器属于 18 世纪清代乾隆时期的“痕都斯坦风格”;在面对烧脑的逻辑题时,它同样展现出硬核的推理能力,在一项需要在脑海中拼合立方体的高难度空间推理题中,虽然不开思考模式容易给出错误答案,但一旦开启深度思考并耗费了长达 4 分钟左右的时间,最终给出了正确的答案;此外,它还被验证了极强的“网感”,上传时下流行的表情包或梗图,它能精准识别合照中的人物(例如从一张合影中同时精确区分出特朗普和鲁路修),甚至能解读出小猫的无奈情绪,准确理解网民的转发笑点;在生产力方面,它还可以充当万能的“截图转码器”,直接将包含代码、复杂 UI 界面的技术报告或网页截图进行解析,提取出所有文字,甚至能一键反向生成可交互的 HTML 代码,连原网页的跳转按钮都能原封不动地予以复原。

伴随着识图模式的上线,DeepSeek 上月底还公开了其背后的多模态模型技术细节,公布了一种名为“Thinking with Visual Primitives(以视觉原语思考)”的核心框架。

据 DeepSeek 发布的技术报告解释,传统多模态大模型在面对密集场景时存在一种名为“指代鸿沟”的困境,模型虽然能看见图片,但在推理过程中用“左边那个大的”等模糊的自然语言构建逻辑链时,很容易因描述不准导致注意力漂移。

DeepSeek 给出的解法是,将点、边界框等代表空间位置的视觉元素直接融入模型的推理链条,使其成为“思维的基本单元”。这种创新框架使得模型在推理时就像人类用“赛博手指”在脑海中精确指出目标物一样,边想边指,从而完美解决了复杂空间布局中的逻辑难题。

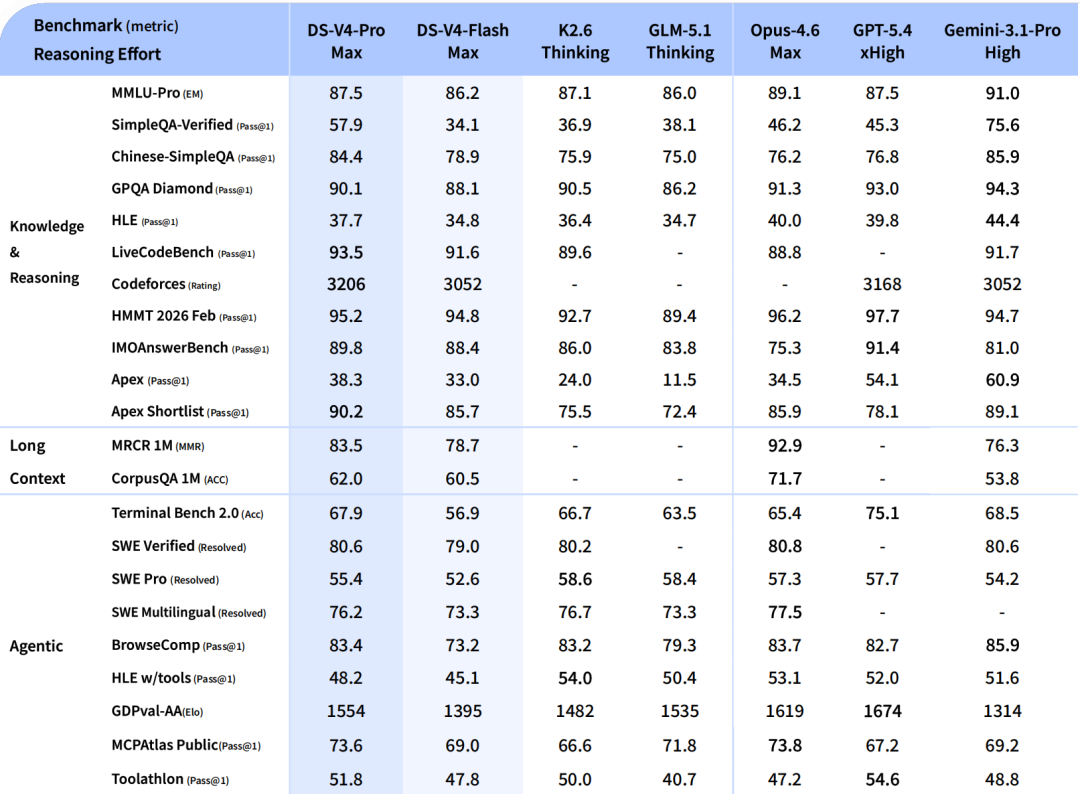

更令人惊叹的是,这种高效的框架在实际运算中对算力资源非常友好,在处理一张 800×800 分辨率的图片时,DeepSeek 仅消耗约 90 个 tokens,而 GPT 和 Claude 等其他主流模型在处理同等图片时则需要消耗约 870 到 1100 个 tokens,且 DeepSeek 在多项计数与空间推理的基准测试上达到了比肩甚至超越了前沿模型的水平。

另外需要提醒的是,刚学会“睁眼”的 DeepSeek 并没有大家想象中那么完美。综合大量用户实测反馈来看,目前的识图模式仍存在几处明显不足:

-

首先是知识库更新的滞后性,在某些测试中,虽然模型的推理过程和分析逻辑完全正确,但最终答案却张冠李戴 —— 例如在识别某款 2025 年底发布的最新型号手机时,因其知识库停留在 2025 年,虽然能通过副屏细节推断出旧型号,但仍给出了完全错误的具体型号;

-

其次,在面对数图中老虎数量、视错觉等高难度反直觉图形题目时,它的答案依然存在很大的不确定性,甚至有时在经过长时间“深度思考”后,反而出现了更严重的幻觉,导致最终逻辑崩溃。

还有一点需要明确的是,目前 DeepSeek 上线的识图模式本质上是纯视觉理解模块,它主要集中在图片识别与分析层面,尚未集成图像生成、视频理解或跨模态交互等更为广义的多模态功能。

(来源:DoNews)