从AI监管到内容生态重构:平台正在重新定价“真实”

撰文 | 曹双涛

编辑 | 杨博丞

题图 | 豆包AI

“割裂”正成为2026年AI创作圈最真实的状态。

左手是被市场包装出的AI创作暴富叙事:DeepSeek指令+番茄小说,月赚5万;零基础学习AI图文带货,首月带货6万+单;AI写作+“养龙虾”+批量矩阵账号日发千条、年入百万;7天速成AI漫剧,可接高达每分钟200元到500元的商单。

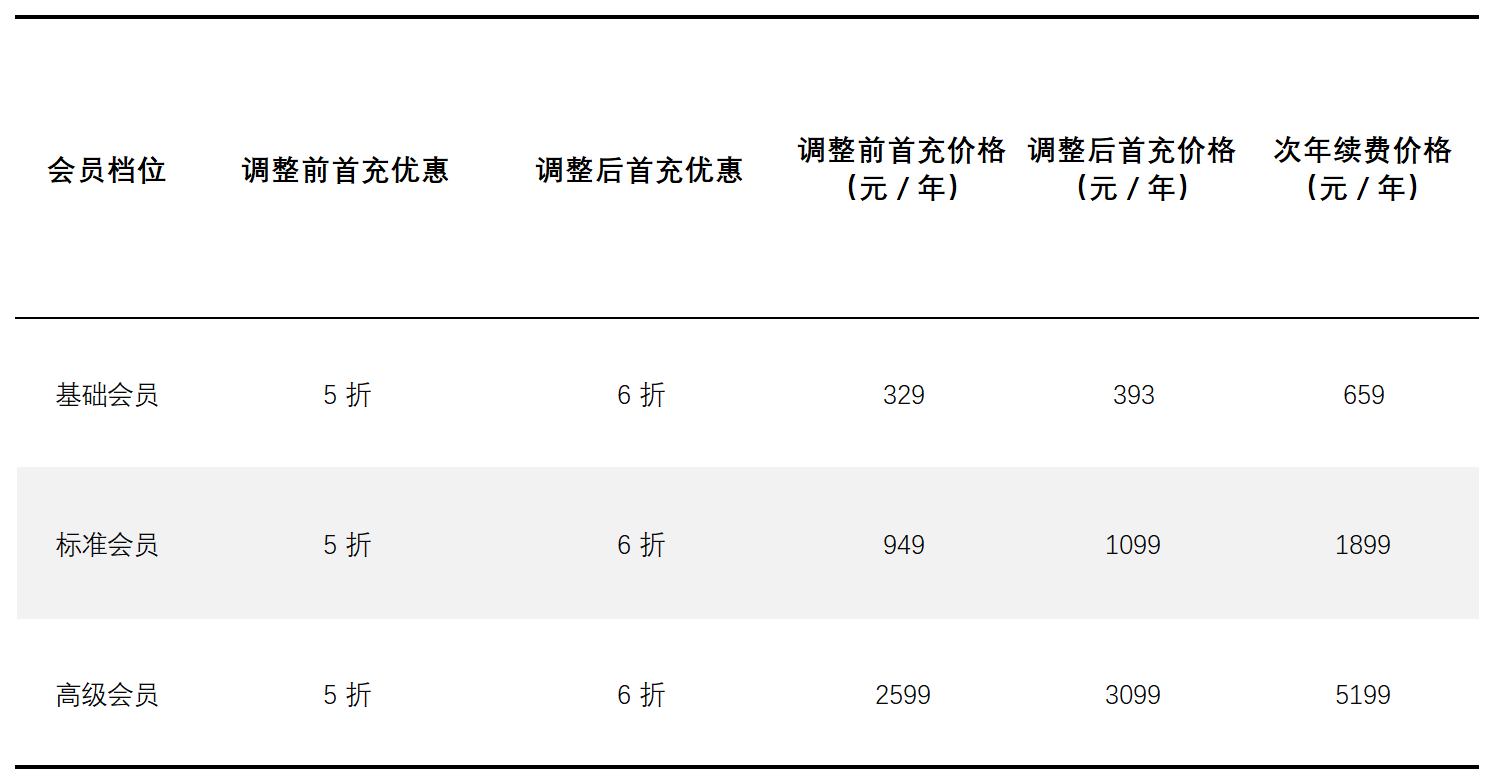

右手却是市场冷酷的信用清算:大量内容平台对AI生成内容的监管愈发严格;即梦会员涨价、积分缩水生成需排队,生产成本持续上涨;季冠霖、边江工作室、729声工场等头部配音机构接连出手,打响声音主权保卫战。

图源:基于公开信息整理(即梦会员涨价对比)DoNews制图

割裂背后,也给市场带来更多冷思考:内容平台为何持续强化对AI内容的治理与规范?AI究竟为创作者沉淀了多少可复用的核心资产,还是只留下批量堆砌的低质内容?那些被反复追捧的“AI增效”价值叙事,在现实考验中又真正落地了多少呢?

01、全球内容平台监管升级中

针对AI生成内容的监管持续收紧,已成为2026年全球主流内容平台的共识和趋势。

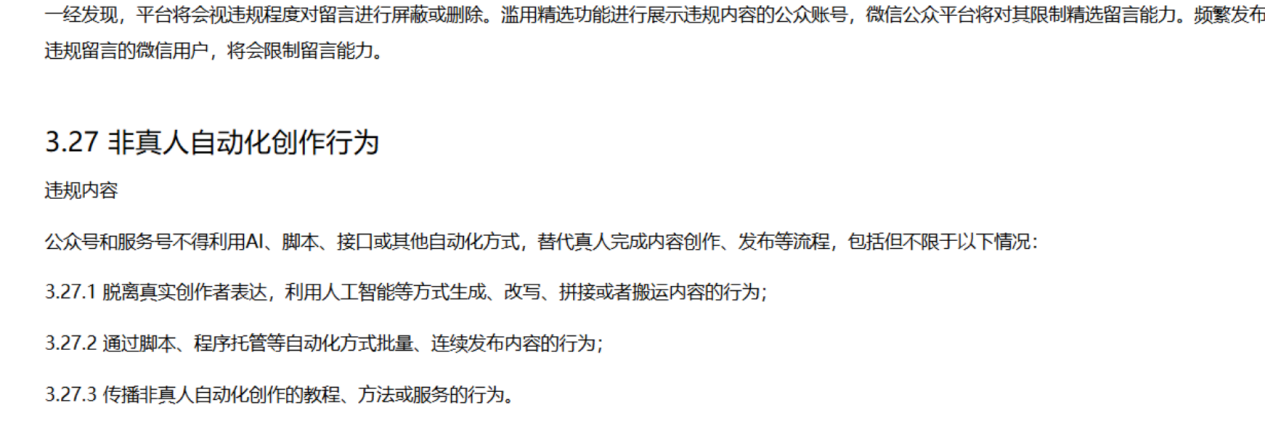

国内继3月小红书全面封禁纯AI托管账号后,4月微信公众平台也为完全依赖AI创作的账号划定明确红线。新版《微信公众账号行为规范》明确要求:公众号与服务号不得借助AI、脚本、接口或其他自动化工具,替代真人完成内容创作、发布等全流程运营;一旦触碰红线,平台将采取限流、删文、功能限制、账号封禁的处罚。

图源:《微信公众账号行为规范》

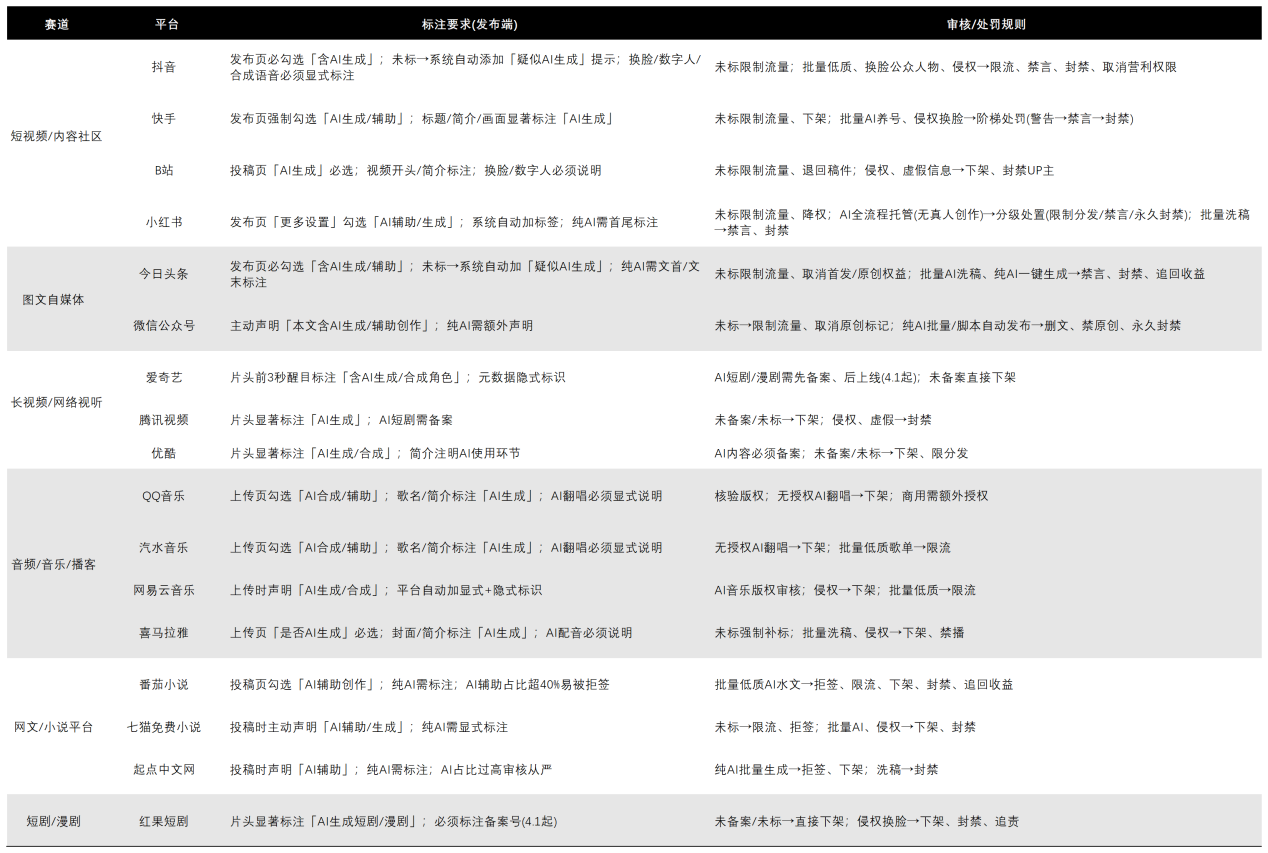

微信公众平台的监管并非个案,我们梳理国内短视频/内容社区、图文自媒体、小说、短剧、长剧、网络视听、音频/音乐/播客等多领域平台的AI监管政策后发现:

图源:基于公开信息整理 DoNews制图

当前各大内容平台均要求创作者在片头前3秒、标题或封面等显著位置进行醒目标注——“内容由AI生成,疑似使用了AI技术,请谨慎甄别”。对未标注或违规使用AI的内容,限流、降权、下架是平台的常规操作。这些处罚,直接关乎创作者的收益与账号生死。

更关键的是,标注不等于“免罚通行证”。对完全依赖AI自动化生成、批量发布、缺乏真实表达与原创增量的内容,即便已按要求完成标注,平台仍可能基于内容低质、低价值或非真人自动化创作等判断,进行各种处罚。

不过由于各平台属性存在差异,监管细节也有所不同。例如,小说平台的编辑在审稿时,若发现稿件存在AI注水剧情、过度堆砌环境描述,或是滥用小众词汇等典型“AI味”的稿件,将直接被打回。

而在版权风险更高的短剧、仿真剧、长剧集领域,平台则通过提高准入门槛、强化事前核验来严控风险。以红果短剧为例,2026年Q1,该平台已累计下架违规漫剧1718部。

这种对AI低质内容的警惕,已延伸到行业上下游——目前部分甲方明确表示,只要合作方用AI生成大纲或初稿,就直接拉黑、永不合作。

不难看出,当前内容平台对AI生成内容的治理,正从零散的规则要求,升级为全行业统一的行为准则,监管已全面覆盖“发布—审核—分发—变现—账号”的全流程,形成闭环管控。整个行业围绕AI内容监管的共识愈发清晰:合规透明、鼓励辅助、严惩滥用、保护原创。

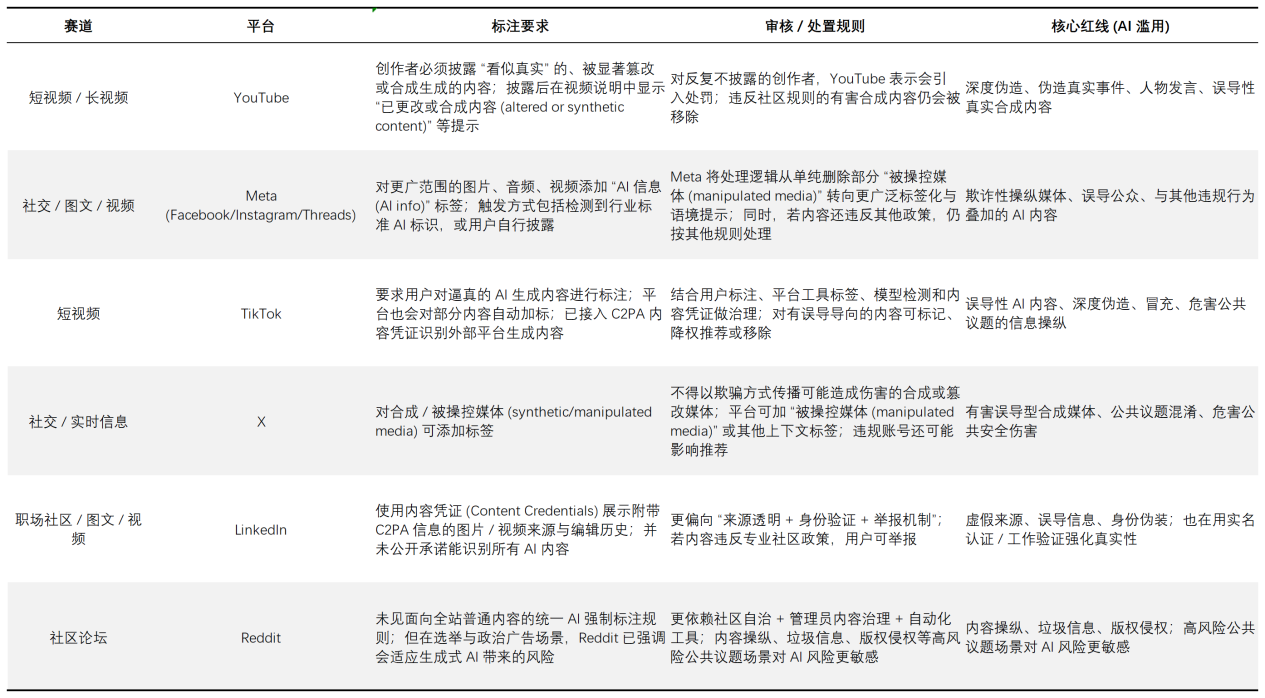

而我们在梳理YouTube、TikTok、X、Facebook海外主流内容平台的监管政策时发现,当前采取的是“高风险内容强制披露、普通AI内容引导标注”的分级模式:平台仅要求创作者对“看起来真实、可能误导公众”的逼真合成、深度伪造内容进行披露;对于普通的AI辅助创作,并不做全量强制标注要求,核心聚焦于防范AI内容误导用户、伤害公共利益。

图源:基于公开信息整理 DoNews制图

其中,YouTube要求创作者披露逼真合成内容;TikTok通过创作者自主标注、系统检测模型、内容凭证溯源三者协同,识别AI生成内容;Meta通过“AI info”标签标注,搭配高风险场景降权,降低AI内容的误导风险;X则将治理重点放在“可能造成伤害的误导性合成内容”上。

海外“分级管控”与国内“全覆盖强制披露、发布端严格管控”的模式形成反差,背后是中外监管路径的差异。国内《关于规范短视频内容标注工作的指导意见》明确要求,AI生成、摆拍创作、虚构演绎、商业推广四类内容,必须强制标注。

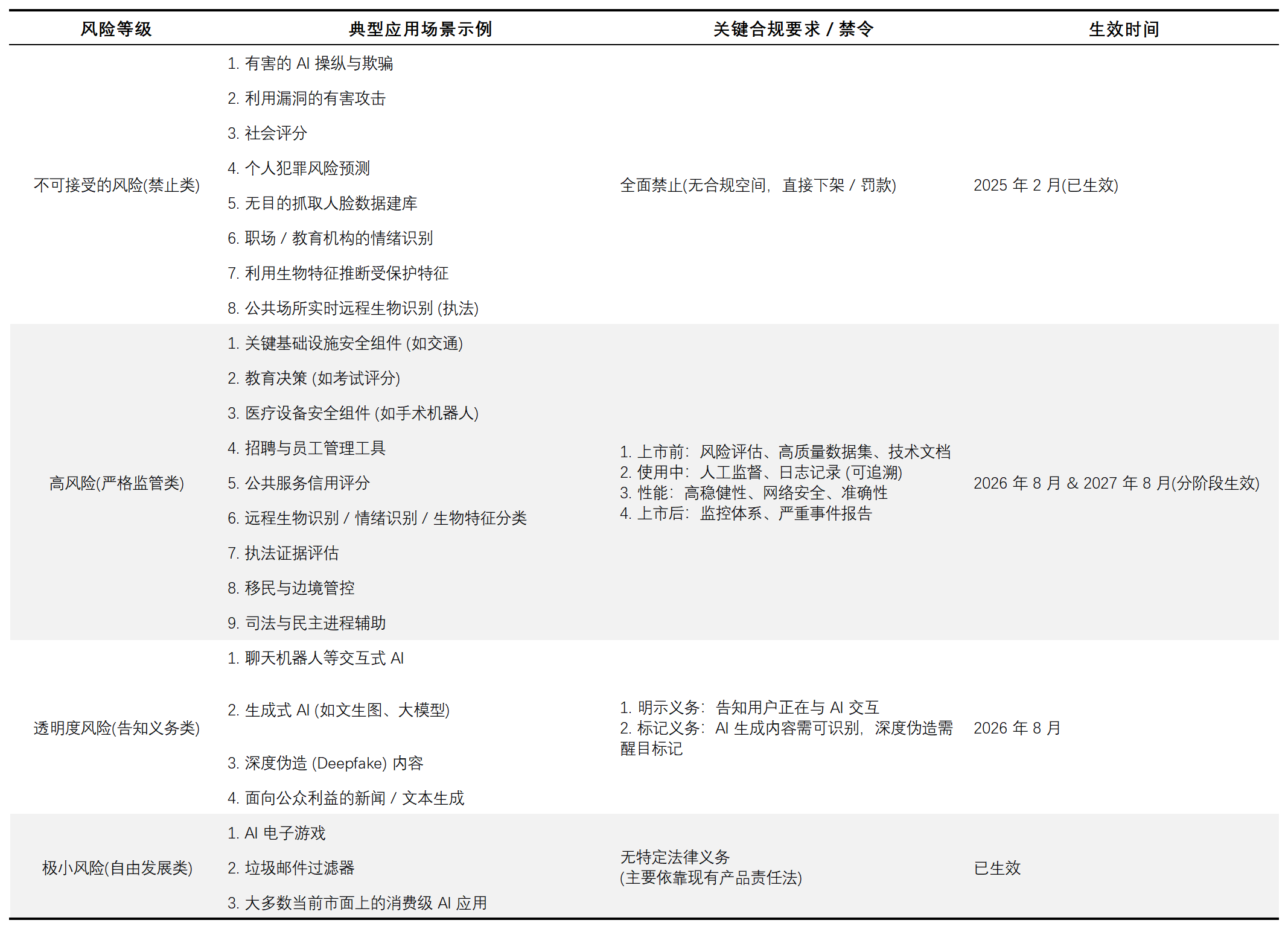

欧洲《人工智能法案》则将AI系统的风险划分为四个等级:不可接受的风险、高风险、有限风险、极低风险或无风险。其中,面向公众利益的新闻被纳入“透明度风险”范畴,需履行相应的披露义务。

图源:基于公开信息整理 DoNews制图

尽管中外监管路径存在差异,但核心共识高度一致:AI内容并非不能存在,但其必须可识别、不可滥用,尤其不能借着“高仿真度”误导用户、伤害公共利益、侵蚀平台信任。说到底,全球法律层面的监管,针对的从来不是AI技术本身,而是“用AI伪装真实”的违规行为。

更关键的是,当前海外内容平台的治理逻辑,与国内平台高度趋同。YouTube表示,内容能否获得更多推荐,关键看内容本身的质量与合规性,和是否使用AI无关;TikTok同样强调,不会因内容使用AI、标注AI标签,就降低其分发权重,但对于误导性、违规性的AI内容,仍会果断采取降权、移除等处置措施。

至此,全球内容平台对AI生成内容的监管边界已愈发清晰:所有主流平台打击的,都是借AI批量生产低质、虚假、误导性内容的行为。平台真正担心的,是那些“看似是内容,却毫无价值”的产物不断泛滥,最终冲垮平台长期建立的真实、原创、优质内容定价体系。

02、被高估的速度,被低估的返工

这轮内容平台监管升级的底层逻辑,早已超越单纯的技术治理,本质上是内容平台在“创作效率”与“内容真实”之间,重新划定秩序边界。与之而来的问题是:AI为内容创作带来的“降本增效”叙事,在现实中是否真正兑现。

“AI大模型本质上是在玩一种‘猜字游戏’。”来自杭州的AI算法工程师林阳(化名)说。在他看来,大模型的生成能力依赖前期投喂的海量预训练数据,只是学习数据中词语、句子之间的关联规律,再依靠概率去“猜”下一个内容;一旦超出训练数据范围,就很容易一本正经地胡说八道。而且喂进去的数据多,也不等于最终结果就一定可靠。

林阳提到,他日常开发中一天可能消耗一两亿token,但真正有效的产出极少,大量token都耗费在投喂参考资料、补充背景信息与检索内容上。

也就是说,想让AI产出高质量的文本或代码,前期必须投入大量精力准备素材、搭建框架、反复引导,这才是决定最终质量的关键。

大模型的底层算法逻辑,也决定了其能力边界:它更擅长处理标准化、流程化的任务,比如生成标准化文案、编写简单代码、制作基础图文,这类任务通常不需要深度推理;可一旦面对需要深度逻辑、真实经验或独特观点支撑的场景,比如行业深度分析、深度原创创作,就很容易出现偏差、掉链子。

如林阳所言,AI确实在内容创作的部分环节带来效率与创意上的提升。以影视创作为例,《The Late Show with Stephen Colbert》团队表示,单个镜头的抠像工作可以从5小时压缩至5分钟;业内也有高管预期,VFX与3D资产制作环节有望实现80%—90%的效率提升。

内容创意层面,短视频平台上豆包VS千问VS元宝的“AI宫斗大战”一度走红;不少博主启用“毒舌豆包”模式,金句频出、传播力极强。比如,“宝宝,你为什么要在肚子盖三层楼啊?”“马戏团禁止动物表演。”“这都开春了,你为什么还要穿棉袄呢?”“你是在肚子上种了肉的种子吗?”

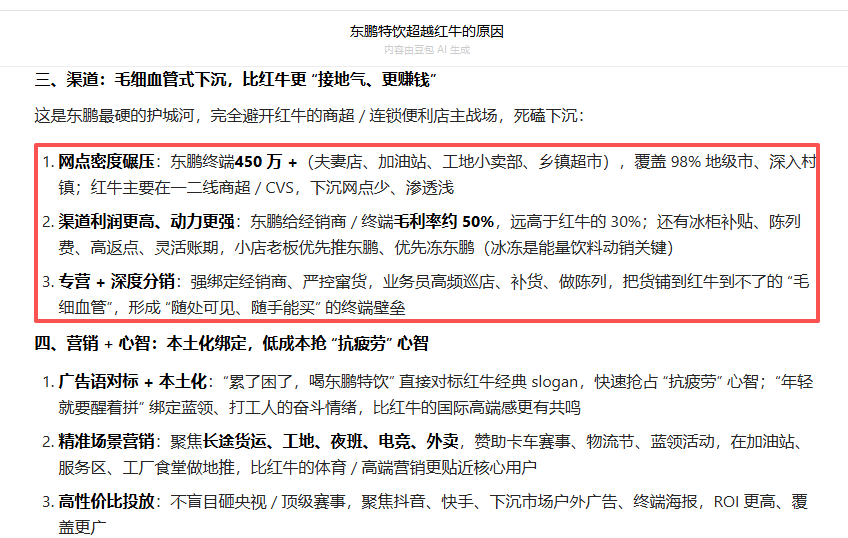

然而,局部效率的提升,并不等于整体创作成本真正下降。当我们向豆包提问“东鹏特饮为何超过华彬红牛”时,豆包给出的回复是:“红牛下沉不足,东鹏给经销商/终端的毛利率约50%,远高于红牛的30%。”

图源:豆包AI

“东鹏特饮与华彬红牛留给终端的毛利率均在20%—25%,东鹏两级(经销商+终端)渠道加带奖营销激励约40个点;华彬红牛更早深耕全国渠道,东鹏的经销商账期也并没有想象中灵活。”从事软饮料销售多年的胡杨(化名),对豆包的回复提出了诸多质疑。

当中文语料被大量污染、一手真实信息愈发稀缺,创作者又不得不花费更多时间复核、校对和纠偏时。这也从侧面说明:AI虽让写作速度变快,但大幅推高了事实核验与信息清洗的成本。

相较文本创作,视频创作面临的问题更突出。“既然大模型玩的是概率猜字游戏,用它做视频就必须给出极其细致的关键词。每一秒的人物动作、风格、神态、镜头衔接等,都必须写得非常细,否则极易出现场景跳跃、时空错乱。例如,上一秒还在雪山,下一秒就切到沙漠;讲述宋代历史故事,画面里却冒出清代辫子或现代人物。”林阳表示。

他进一步说道,这种概率性问题一方面催生了短剧行业的“插卡师”新职业,另一方面也让实际工作量远超外界想象。比如把《鹿鼎记》这种百万字体量的原著做成AI短剧,仅撰写提示词就可能达到千万字级别,还要不断补设定、拆剧情、修镜头、保一致性。真正把人拖垮的,是没完没了的返工。

AI带来的大量返工,正让内容创作变得更累。Connext Global对1000名美国职场人的调查显示:96%的受访者在使用AI后仍需后续修正;46%认为纠错耗时与手工完成相当,11%甚至认为更久;32%表示AI带来了额外返工,31%吐槽AI经常“自信地输出错误内容”。

当AI的真实降本增效远未达到市场预期时,行业反而陷入了一场集体幻觉。北京打工人张峰(化名)回忆,某次投标时,老板要求团队直接用AI写标书,认为“几分钟就能搞定”。结果AI生成的标书漏洞百出:报价算错、客户名称写成友商,甚至在标书嘲讽其他竞品。面对客户的怒斥,团队只能通宵返工,从头人工重写。

这类翻车的核心,并不在于AI完全无用,而在于市场把“局部提效”误读为“整体提效”,把“初稿生成速度”等同于“最终交付效率”。

AI确实加快了部分环节,但也带来了全新的校对成本、信任成本与返工成本。所谓“AI降本增效”的神话,更多是被“生成很快”的速度幻觉不断放大,而非被现实真正证实。 -

03、AI重塑内容行业的规则边界

当“降本增效”的幻觉逐渐被现实击穿,AI创作的能力边界正触碰内容行业最敏感的几条红线:版权、真实性、责任归属与平台信任。这些问题的存在,迫使未来全球内容平台对AI生成内容的监管持续升级。

AI大模型若想持续提升输出质量,就必须依赖更大规模、更高质量的训练数据,尤其是对于强调原创性与时效性的媒体行业来说,这几乎天然意味着版权博弈的升级。

以GPT为例,从2023年底《纽约时报》起诉开始,到2024年多家美国新闻媒体与调查机构跟进,再到加拿大主流新闻机构联合行动,直至2025年大型数字媒体集团Ziff Davis加入诉讼阵营,针对OpenAI的维权已从个体媒体行为,演变为新闻与数字内容行业的系统性追责。

图源:基于公开信息整理 DoNews制图

这些案件的核心争议高度一致:AI企业是否在未经许可的情况下抓取媒体内容进行训练,以及模型输出是否进一步侵蚀媒体内容的版权价值、流量价值与品牌归属。

而部分内容版权的保护仍处在盲区中,进一步放大了这种问题。以声音权为例,《哪吒2》太乙真人配音演员张珈铭在接受媒体采访时表示,其为制止AI盗声行为投入近10万元维权,但由于侵权主体分散、部分甚至为未成年人,实际追责困难,至今未有明确判例。这意味着,在AI大规模生成能力之下,传统版权与人格权的保护机制,正遭遇执行层面的挑战。

版权问题尚未理清之际,AI错误带来的权责划分更为棘手。当AI开始“一本正经地胡说八道”,而这些内容又被媒体采纳、被平台分发、被创作者继续使用时,责任边界就会迅速变得模糊。

例如,CNET使用AI生成的77篇文章中,有41篇被指出存在问题,这让其对AI写稿转向极度保守;Gannett推出的自动化高中体育战报实验,因生成大量“难以理解的体育描述”而被紧急叫停;NewsBreak利用AI改写的聚合内容,因虚构本地枪击案引发严重舆论争议。

这些海外案例充分说明:一旦AI内容进入“生产—编辑—分发”的完整链条,问题就不只是“稿子写得差”,而是会演变为对公众认知的误导,甚至触及平台、媒体与创作者之间的责任划分难题。

而当版权冲突与责任风险继续向平台内部传导,最终被侵蚀的,是平台赖以生存的内容生态与商业基础。在当前用户注意力极度稀缺的环境下,内容平台留住用户与广告主的核心,依然建立在优质内容之上。可当大量低质、同质化的AI内容无节制涌入,就会直接冲击平台的用户信任与内容生态稳定性。

例如,短视频平台上的AI生成照片与视频虽然精致,却缺乏真实感;AI小说剧情套路化、情绪空洞,AI文章“AI味”过重、缺乏观点,AI数字人直播则显得机械、缺乏代入感。

这意味着,AI正在迫使内容平台在“效率”与“真实”之间重新做出选择。如果过度倾向效率,平台可以在短时间内放大内容供给,但代价是内容质量被稀释、信任被透支;而一旦信任受损,用户停留时长与广告价值也会随之下降。

以BuzzFeed为例,2023年其高调押注AI内容与应用,不仅股价从3美元飙升至15美元,更被视为“AI内容商业化”的标杆案例。

但“All in AI”战略,却让BuzzFeed迎来全面失速:2025全年净亏损扩大69%至5770万美元,广告收入同比下降2.8%至9170万美元,全年营收同比下滑2.4%至1.853亿美元,用户内容停留时长同比下降约7.2%。长期徘徊在70美分的股价,更让其面临被纳斯达克摘牌的风险。

AI可以放大内容产量,却未必能提升内容价值。一旦价值无法同步提升,不仅无法推动流量与广告增长,甚至可能因内容质量下降,进一步流失用户与广告主——尤其是在广告预算吃紧的当下。

也就是说,AI正在重写内容行业的竞争规则。平台之间的竞争,不再只是争夺内容供给规模,而是转向争夺真实性、可验证性以及责任闭合能力。未来真正有竞争力的平台,并不是AI用得最多的平台,而是最能把AI的生产效率与真实的内容信任重新组织起来的平台。

(来源:DoNews)