Nature:神经网络"举一反三"能力甚至超人类 | 量子位

Nature:神经网络“举一反三”能力甚至超人类

错误率仅百分之一

神经网络具有类似人的“举一反三”能力,甚至超过人类水平???

最近刊于Nature的一篇论文表示找到了证据。

“举一反三”、系统概括的能力更专业点叫做系统性泛化能力。像小孩子一样,一旦学会了如何“跳”,他们就可以理解如何“向后跳”、“绕锥体跳过两次”。

要知道,早在1988年,认知科学家Fodor、Pylyshyn就提出了系统性挑战,认为人工神经网络缺乏这种能力。

Nature的这篇文章中表示,研究人员用一种叫做MLC(meta-learning for compositionality)的方法,通过在动态变化的组合任务流中训练,神经网络可以获得人类般的组合推理能力。

他们还将MLC和人类在相同的系统性泛化测试中进行了比较。结果机器学习的系统性泛化基准测试表明,MLC错误率不到1%,并且还可以模拟人类的认知偏见导致的错误。

相比之下,GPT-4 在相同的任务中平均失败率在42%到86%之间,具体取决于研究人员如何提出任务。

挑战已存在35年的观点

35年前,认知科学家Fodor、Pylyshyn提出了一个著名的观点:

换句话说,人类语言和思维的精髓在于系统性组合,而神经网络只能表示特定的事物,缺乏这种系统性组合能力。

这个观点引发学界激烈讨论。其中反驳观点主要集中于两个方面。

一是尽管人类的组合技能很重要,但它们可能并不具有Fodor、Pylyshyn所说的那样的系统性和规则性。

二是虽然神经网络在基本形式上受到了限制,但使用复杂的架构可以增强系统性。

虽然最近几年,神经网络在自然语言处理等方面有了很大进展和突破,相关辩论也随之升级。

但时至今日,系统性的问题仍没有一个定论。

基于此,纽约大学心理与数据科学助理教授Brenden M. Lake、西班牙加泰罗尼亚研究所(ICREA)研究教授Marco Baroni提出了一种叫做MLC的元学习神经网络模型。

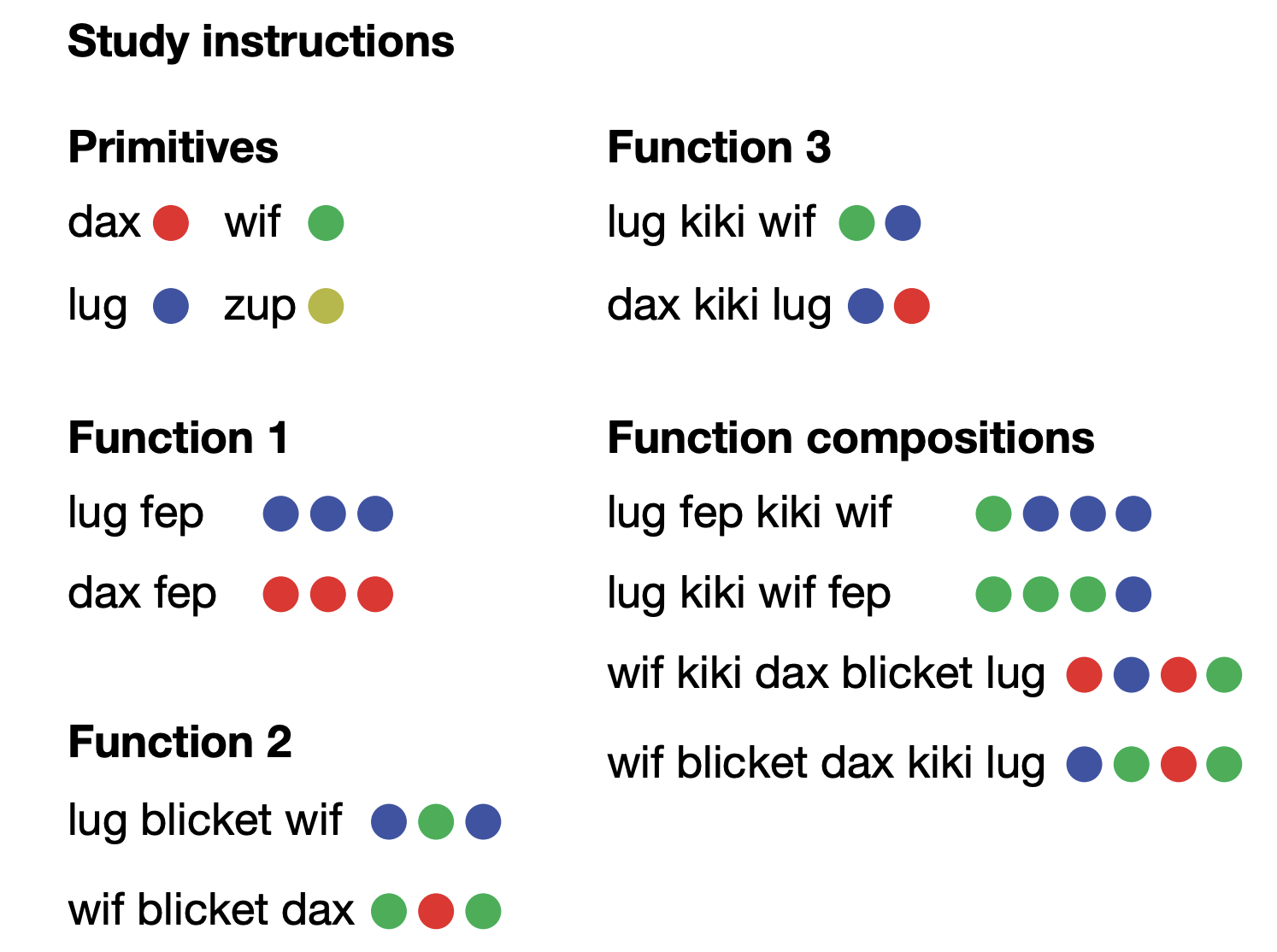

具体来说,用的是一种通过特殊指导和人类示例来指定模型行为的方法,然后要求神经网络通过元学习获得正确的学习技巧。

研究人员还表示,MLC使用的是标准的Seq2Seq架构,常见的神经网络并没有添加符号机制,也没有手动设计内部表示或归纳偏见。

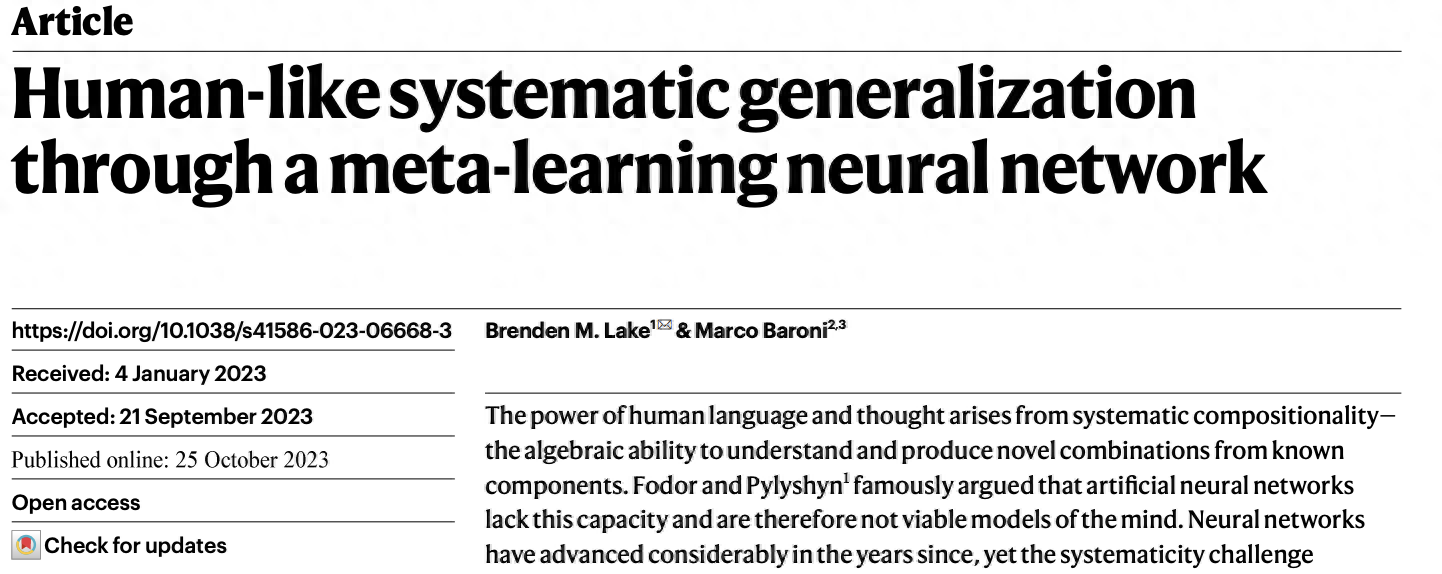

举个例子来说明训练过程。如下图所示,给神经网络模型一个“连续跳跃两次”(skip twice)的指令。并用箭头和小人来展示学习示例,告诉机器jump(跳)、skip(跳过)、jump twice是怎样的。

然后将输出的skip twice和行为目标比较:

类似情境,引入下一个词“向后踮脚尖绕过一个锥体”,要求神经网络组合向后走(walk backwards)、踮脚尖(tiptoe)、绕锥体行走(walk around a cone)的动作,推出如何“向后踮脚尖绕过一个锥体”。

机器VS人类

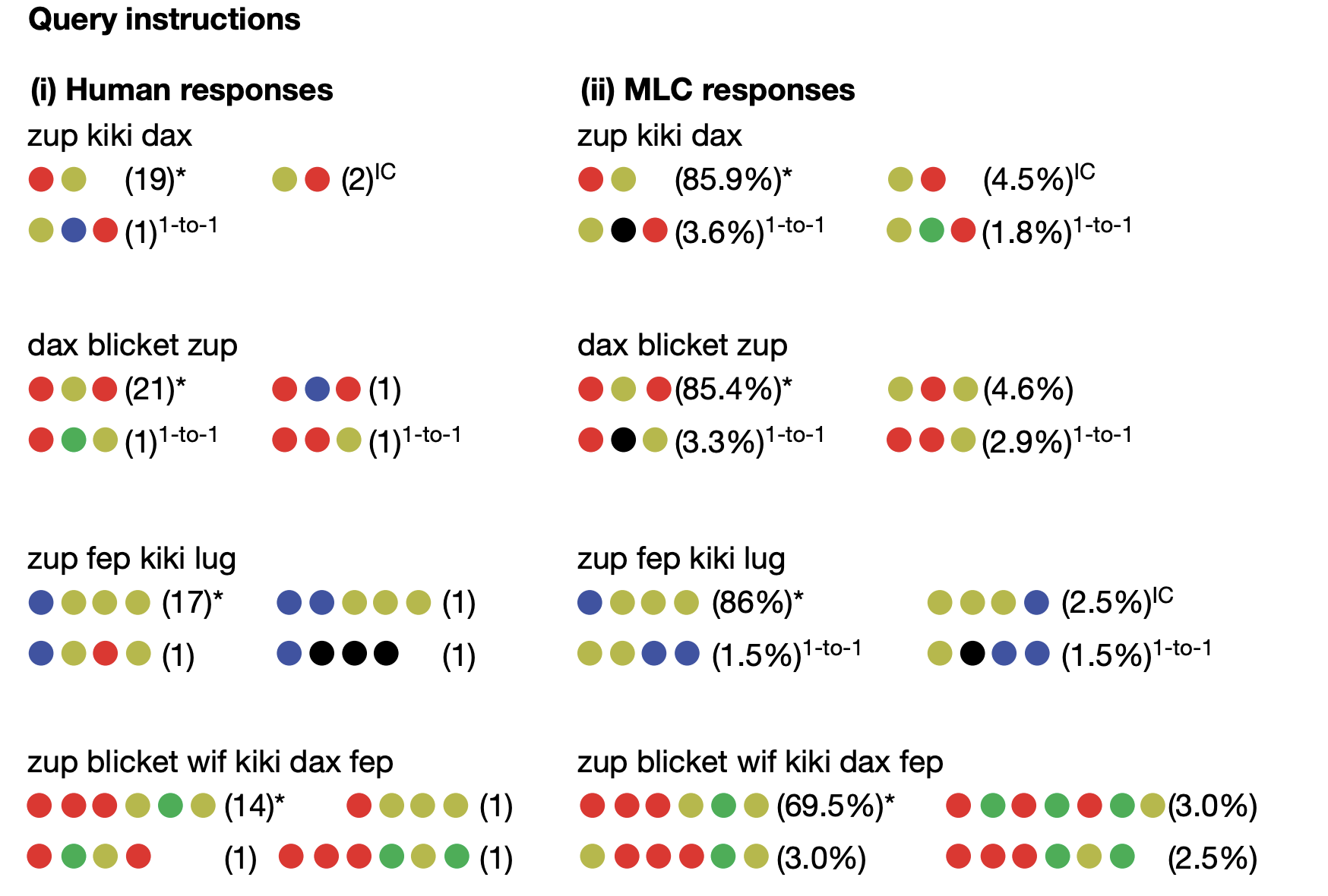

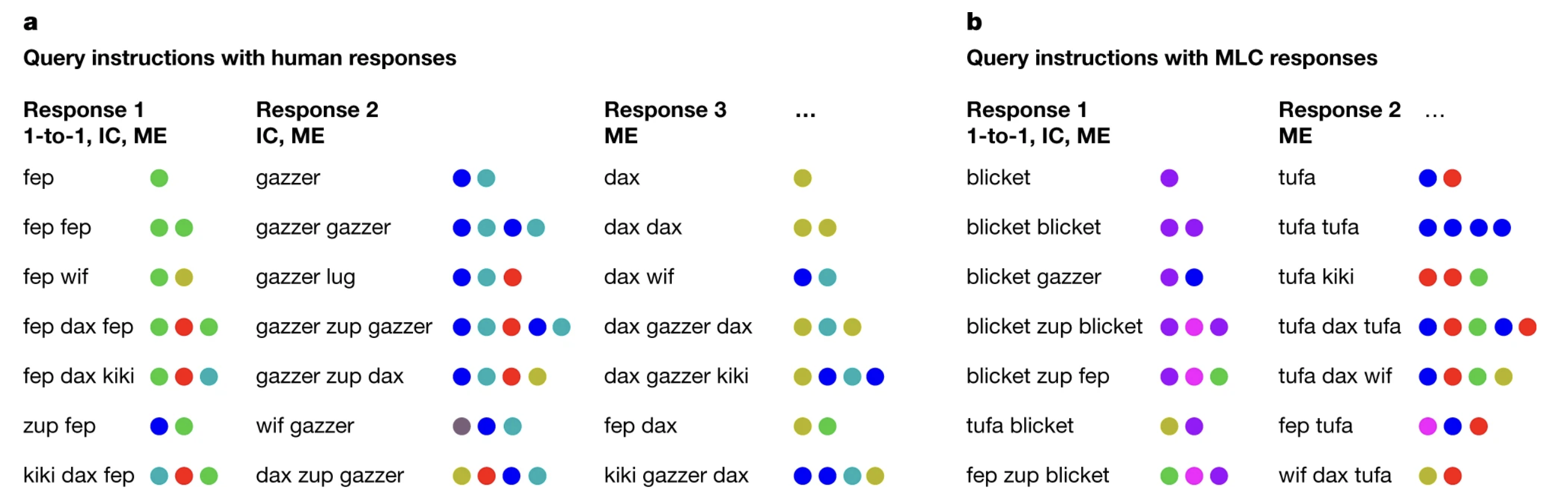

为了展示MLC方法的性能,研究人员对人类和机器在相同的系统性泛化测试中进行了评估。

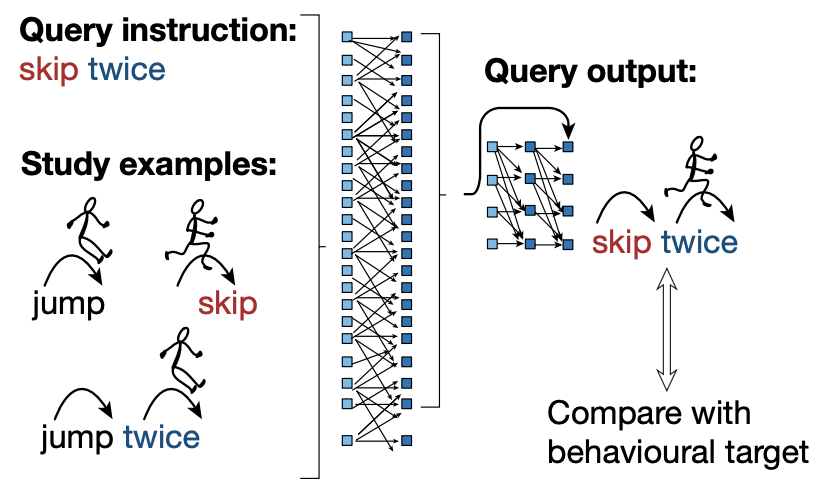

实验基于一个少样本学习伪语言任务进行,其中词汇与特定的符号或颜色有关。

比如给出基本词汇,“dax”是红色,“wif”是绿色,“lug”是蓝色。

还有三个Function。Function 1中,“lug fep” 代表三个蓝色的连续圈圈,“dax fep” 代表三个红色的连续圈圈。

Function 2代表的是交替,像“lug blicket wif” 代表蓝绿蓝三个颜色的圈圈。

Function 3代表把输出顺序倒过来,像“dax kiki lug” 代表蓝红(根据基本词汇应该是红蓝)。

还可以组合不同的Function,比如“wif blicket dax kiki lug”是蓝绿红绿。

△MLC架构

然后研究人员对25名人类的反应和机器的反应进行了比较:

研究人员还测试了在不给出任何示例的情况下,人类和机器归纳这种方法后的输出,为的是测验人类的归纳偏见:

测试后的结果表明,人类能够系统性地泛化,正确率约为80%,但也存在一些偏见。

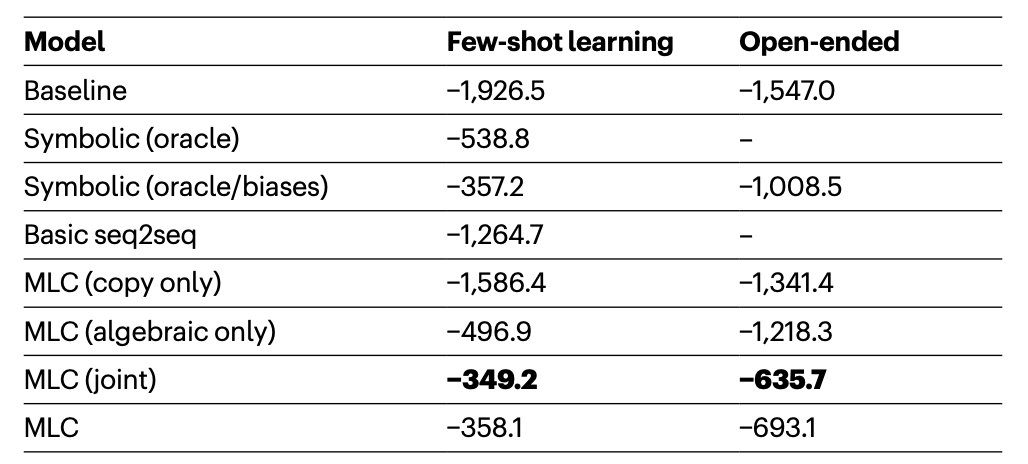

而使用MLC方法机器可以达到或超过人类的系统性泛化水平。

MLC还可以预测哪些指令对人们来说更容易或更难。

下图展示了模型预测人类行为的log-likelihood值(用来判断模型预测数据的好坏),数值越大表示模型的预测越准确:

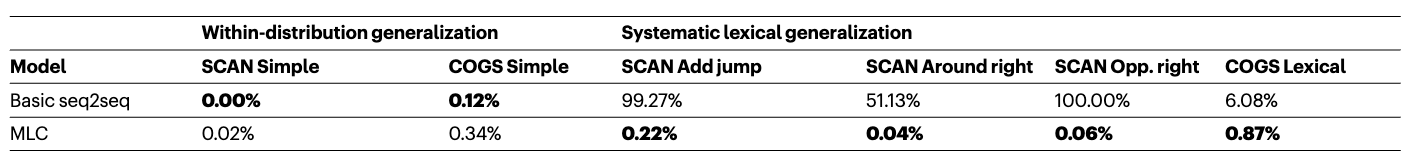

研究人员还在两个常见的机器学习的系统性泛化基准测试SCAN、 COGS中,着重关注MLC处理新单词和单词组合方面的表现,结果显示错误率不到1%。

△在机器学习基准测试中进行系统性词汇泛化的错误率

他们还表示,在纯粹的代数推理和模拟人类复杂组合行为的情况中,MLC还可以模拟人类的认知偏见导致的错误模式,这说明神经网络是一种很好的建模工具。

引发热议

美国圣达菲研究所的计算机与认知科学家Melanie Mitchell表示:

德国奥斯纳布吕克大学自然语言处理专家Elia Bruni表示:

但也有网友指出Nature的标题有点唬人了:

还有网友表示用这种方法能够击败GPT-4是因为提示的问题:

论文链接:https://www.nature.com/articles/s41586-023-06668-3

参考链接:

[1]https://www.nature.com/articles/d41586-023-03272-3

[2]https://news.ycombinator.com/item?id=38017146

(来源:量子位)